28 Şubat 2026’da ABD ve İsrail’in İran’a karşı başlattığı saldırıda sadece savaşı yakından izleyenlerin fark ettiği önemli bir gelişme oldu. Bu, bombaların kendisinden çok daha az dikkat çekti. Büyük bir askerî harekatta ilk kez yapay zeka, hedeflerin nasıl belirlendiği, önceliklendirildiği ve vurulduğunun temel mimarisine entegre edildi. Bir eşiği aştık.

Bu anın bizi yüzleşmeye zorladığı sorular teknik değil; siyasi, hukuki ve ahlaki sorular. Savaşta insan eyleminin doğası, giderek makinelere devredilen kararlar için devletlerin hesap verebilirliği ve uluslararası düzenin, onları düzenlemek için tasarlanmış kurumlardan daha hızlı gelişen teknolojileri yönetme kapasitesi veya yetersizliği ile ilgilidir. Hızlı teknolojik gelişme, uluslararası tartışmanın yavaş ilerleyişini çoktan geride bırakıyor. İran çatışması bu açığı görmezden gelmeyi daha da zorlaştırdı.

Veriden ölüme: Yapay zeka hedefleme nasıl çalışır?

İran çatışmasında yapay zekanın rolünü anlamak için, bu sistemlerin aslında ne yaptığını ve ne yapmadığını anlamak faydalı olacaktır. Popüler algının bazen öne sürdüğü gibi, bağımsız kararlar alarak öldürme yetkisine sahip özerk ajanlar olarak çalışmazlar. Temelde yaptıkları eylem, farklı katmandaki devasa veriyi karar verilecek seçenekler olarak sunmak ya da eyleme geçirmektir. İhtimaller, risk ve birden fazla etken hesaplanarak sunulan bu panel, çok seçenek arasında karar vermek zorunda olan insan muhakemesini zorlar. Karar verme destek sistemi olarak sunulan bu yapılar, ürettikleri seçeneklerin çokluğu ve hızıyla kendilerini onaylaması gereken kişilerin bilişsel yapısının sınırlarını zorlar.

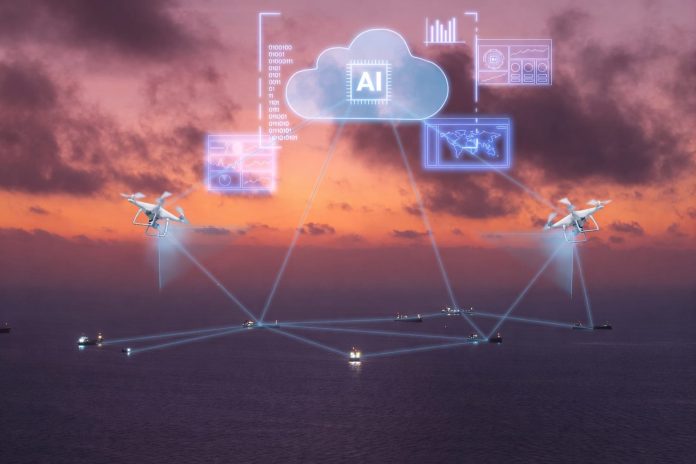

Temel mimari şu şekilde çalışır: Uydu görüntüleri, sinyal yakalama, açık kaynak verileri, gözetim kayıtları, tarihsel kalıpların analizi gibi çoklu kaynaklardan gelen istihbarat, hiçbir insan analistinin ulaşamayacağı bir ölçekte işlenir. Yapay zeka sistemi daha sonra yapılandırılmış çıktılar üretir: sıralı hedef listeleri, tehdit değerlendirmeleri, olasılık puanları, öngörülen ikincil hasar tahminleri. Bir komutan bu çıktıları inceler ve harekete geçme yetkisini verir. Biçimsel olarak, insan süreçte yer almaya devam eder.

İran’daki ABD operasyonunun merkezindeki sistem, görüntü işleme, istihbarat analizi ve taktik destek gibi uygulamalar için yapay zeka kullanan bir platform olan Maven Akıllı Sistemi’dir. Maven Projesi, şimdilerdeki Savaş Bakanlığı’na amiral gemisi yapay zeka yetenekleri sunma amacıyla 2017’de kuruldu. 2023’te Ulusal Jeo-uzamsal İstihbarat Ajansı’na (National Geospatial Intelligence Agency – GA) devredildi ve Maven adıyla kayıtlı bir program haline geldi.

Bu noktada jeouzamsal istihbaratın ne olduğundan da kısaca bahsetmek gerekir. Jeo-uzamsal veriler, Dünya yüzeyindeki konumlarla ilgili bilgileri içeren verilerdir. Nesneleri, olayları ve diğer gerçek dünya olaylarını enlem ve boylam koordinatlarıyla tanımlanan belirli bir coğrafi alana eşleyerek işleyebilirsiniz. Jeo-uzamsal veriler, konum bilgilerini belirli bir süre boyunca diğer iş veri kümelerinin özellikleri veya öznitelikleriyle birleştirilerek kullanılır. Yemek siparişi uygulamaları bu sistemin en güzel örneğidir. Siparişi verirken bulunduğunuz konumu enlem ve boylam bilgisiyle belirleyerek size en yakın restoranları ve kuryenin yerini gösterir. Bu konum bilgisi, trafik, teslimat süresi ve yoğunluk gibi diğer verilerle birleştirildiğinde jeo-uzamsal verinin günlük hayattaki kullanımına örnek olur.

Savaş Bakanlığı’nın bu sistemi Ulusal Jeo-uzamsal İstihbarat Ajansı’na devretmesi daha geniş ve derin bilgi ağıyla beslenmesini sağladı. Maven, aynı zamanda, özünde ABD Savaş Bakanlığı tarafından tüm askerî hizmetler (kara, hava, deniz, uzay ve siber) ve müttefikler genelindeki sensörleri ve atış sistemlerini tek bir ağda birleştirmek üzere tasarlanmış çerçeve olan Birleşik Müşterek Tüm Alan Komuta ve Kontrol (CJADC2) yapısına entegre edildi. Yapay zeka, makine öğrenimi ve bulut bilişimi kullanarak savaş alanında hızlı, veri odaklı kararlar alınmasını sağlar ve parçalanmış sistemleri entegre bir “askerî nesnelerin interneti”ne dönüştürür.

Bu durum, kullanıcı tabanı giderek genişleyen Maven Akıllı Sistemi’ne olan talebin artmasından kaynaklanır. Söz konusu talep, askerî alandaki stratejik ve taktik operasyonlar arasında birlikte çalışabilirliği güçlendirmeyi ve mevcut Savaş Bakanlığı yatırımlarını temel alarak hazırlık kapasitesini artırmayı amaçlar. Savaş Bakanlığı ile veri analiz şirketi Palantir arasında yapılan anlaşmada da iş akışlarını ve verilerin doğru işlenmesini sağlayacak yeni katma değer olarak Marven projesine katıldı. Palantir’in platformu, yapay zeka destekli savaş alanı farkındalığı, küresel entegrasyon, kuvvet yönetimi, lojistik, ortak ateş gücü ve hedefleme gibi iş akışlarını güçlendirerek, optimize eder.

Maven, hedefleri önererek ve önceliklendirerek saldırı yeteneklerini hızlandırır ve veri analizi yüzünden uzun zaman alacak süreçleri saniyelere indirir. Washington Post ve diğer yayın organlarında çıkan haberler İran’a yönelik saldırılarda Maven’in kullanıldığını doğruluyor, ancak sistemin nasıl kullanıldığı konusundaki “ayrıntılar kamuoyuna açık değil”. Bu nedenle, söz konusu sistemlerin birçok özelliğini tam olarak bilmiyoruz. Maven’in nasıl çalıştığına ilişkin kapalılık başlı başına önemli bir sorun. Çünkü büyük bir askerî çatışmada kullanılan en kritik yapay zeka uygulamalarından birinin, büyük ölçüde kamuoyu denetimi ve demokratik hesap verebilirlik mekanizmalarının dışında faaliyet gösterdiği kanaatine sahibim.

Medyaya yansıyanlar ve gerçeklik arasındaki mesafe

İsrail’in Gazze’de kullandığı yapay zekâ hedefleme sistemleri — Gospel, Lavender ve bunlardan önce 2021’deki Duvarın Muhafızları Operasyonu’nda (Guardians of the Walls Operation) kullanılan Alchemist ile Depth of Wisdom platformları dünyaya bu mimarinin pratikte nasıl işlediğinin ilk ayrıntılı görünümünü sundu. Fakat bu sistemlerin medyada yansıtılan biçimi ile teknik gerçekliği arasındaki mesafe, tartışmanın özünü hem netleştiriyor hem de daha da karmaşık bir hale getiriyor.

İki sistem arasındaki ayrımı doğru kurmak şart.

Gospel bir hedefleme motoru değil; uydu görüntüleri, insansız hava aracı kayıtları, sinyal istihbaratı ve açık kaynak verilerinden derlenen katmanları birleştirerek analistlerin dikkatini potansiyel askerî hedeflere yönlendiren bir karar destek aracıdır. Bu yönüyle Maven ile çok benzerlikler taşır.

Lavender ise teknik olarak bir veritabanıdır: Hamas ve İslami Cihad üyesi olabileceği değerlendirilen bireyler hakkında toplanan bilgileri derleyerek istihbarat analistlerinin erişimine sunar. West Point Lieber Enstitüsü’nden uluslararası hukuk uzmanı Michael Schmitt’in analizine göre her iki sistem de nihai hedefleme kararını vermez; bu kararlar insanlar tarafından, çok aşamalı bir onay sürecinin sonunda alınır. İsrail Savunma Kuvvetleri’nin (IDF) açıklamasına göre analistin değerlendirmesi, daha üst düzey bir istihbarat subayı tarafından gözden geçirilir; ardından hukukçuların da yer aldığı bir planlama hücresine iletilir.

Peki sorun nerede?

Sorun tam da bu sürecin işleyişinin gözlemlenememesindedir. +972 Magazine ve İbranice yayın yapan haber sitesi Local Call’ın haberlerine dayanan raporlar, bazı analistlerin Lavender çıktılarını saniyeler içinde, yalnızca hedefin cinsiyetini doğrulayarak onayladığını öne sürüyordu. IDF bu iddiaları kısmen reddetse de, Schmitt dahil bu alandaki hukuk akademisyenlerinin büyük çoğunluğu, raporların tamamen temelsiz olmadığını kabul ediyor. Schmitt şunu açıkça söylüyor: “Analistlerin sistemin ürettiği çıktıları ek bir değerlendirme yapmaksızın benimsediğine dair haberler, son derece kaygı vericidir. Bu durum tembellikten, makinenin kararına duyulan aşırı güvenden ya da hedef doğrulamasının önemine ilişkin küçümseyici bir tutumdan kaynaklanıyor olabilir.”

Hukuk bu işin neresinde?

Burada hukuki çerçevenin talep ettiği şeyle fiilî operasyonel gerçeklik arasındaki derin uçurum belirginleşiyor. Uluslararası insani hukukun hedefleme kuralları (meşru hedef olup olmadığının tespiti, orantılılık değerlendirmesi ve saldırıda alınacak önlemler) teoride sistematik bir insan yargısını zorunlu kılar. Gospel ve Lavender bu süreci hızlandırabilir, kapsayıcı kılabilir ancak yerini alamaz. Çünkü ne Gospel olası kayıpların büyüklüğünü değerlendiriyor ne de Lavender sivil zarara ilişkin bir orantılılık analizi üretiyor. Bu adımlar ayrı ve bağımsız olarak yerine getirilmek zorundadır. Bir sistemin çıktısının saniyeler içinde onaylandığı bir süreçte, bu adımların gerçekten uygulandığını doğrulamak dışarıdan mümkün değildir, hatta belki de içeriden de.

Bu sistemler, ilke olarak ve doğru biçimde kullanıldıklarında, uluslararası hukuka uyumu artırabilecek kapasitededir. Analistlerin kaçırabileceği bilgileri görünür kılar, güncel olmayan veriye olan bağımlılığı azaltır. Fakat her silah sistemi gibi bu araçlar da kötüye kullanılabilir. Hesap verebilirlik boşluğu teknik değil, yapısaldır. İnsan döngüde olduğunu söylemek yetmez; hangi insanın, hangi bilgiyle, ne kadar sürede karar verdiği de hesap verebilirliğin ayrılmaz bir parçasıdır.

İran harekatı bu modeli daha da ileriye taşıdı. ABD Merkez Komutanlığı Başkanı Amiral Brad Cooper, Amerikalı savaşçıların “çeşitli gelişmiş yapay zeka araçlarından yararlandığını” doğrulayarak, komutanların “düşmanın tepki vermesinden daha hızlı” kararlar alabilmeleri için “saniyeler içinde çok miktarda veriyi tarayabilen” sistemleri tanımladı. Bu çerçeveleme oldukça açıklayıcı: hız, koşulsuz bir erdem olarak sunuluyor ve yapay zekanın değeri, tam olarak karar verme için mevcut zamanı ne kadar kısalttığıyla ölçülüyor. Bu, özünde insanın karar verme sürecini desteklediğini iddia eden ama özünde insan yargısının işlediği alanı azaltma argümanıdır. Nihayetinde önümüzdeki en büyük problem, insan bilişsel yetenekleri ile bilgisayar hızını uzlaştırma problemidir.

İnsan katılımlı süreç doktrini (Human-in-the-loop): Hukuki bir kurgu

İnsanların her zaman nihai hedefleme kararını vermesi gerektiği ısrarı, yapay zekâ destekli savaşın temel meşruiyet iddiası haline geldi. Bu ilke artık askerî söylemden satın alma sözleşmeleri, oradan otonom silahlar üzerine yürütülen her uluslararası tartışmaya dek neredeyse sorgulanmaz bir zemine oturmuş durumda.

Bu doktrin, teoride tutarlı, pratikte ise giderek tutarsızlaşan karar destek ve karar verme arasındaki bir ayrıma dayanıyor. Maven gibi bir yapay zeka sistemi binlerce veri noktasını işleyerek sıralı bir hedef listesi oluşturduğunda ve bir komutan zaman baskısı altında, altta yatan mantığı denetleme yeteneği eksikken bu listeden seçim yaptığında, komutan özgürce karar vermiyor. Makinenin tasarladığı bir menüden seçim yapıyor. Değerlendirmeye alınan seçenekler, ağırlık verilen değişkenler, göze alınan ödünler, bunların tümü, insan henüz devreye girmeden makine tarafından belirlenmiş durumda. İnsan onaylıyor; neyin onaylanabileceğine ise algoritma (en temel anlamıyla: bir bilgisayara verilen ve belirli bir girdiyi belirli bir çıktıya dönüştüren kesin kurallar dizisidir) çoktan karar vermiş oluyor.

Bu durum, uluslararası insani hukuk açısından son derece önemlidir. Ayrım, orantılılık ve ihtiyat ilkeleri, hedef belirleme kararlarının gerçek insan yargısını içermesini gerektirir; otomatik bir sürecin sonunda insan elinin resmî varlığını değil. Hukuk uzmanları, mevcut mimarinin bu testi geçemediğini giderek daha fazla savunuyor. Bir sistem, yaşam tarzı analizi ve olasılıksal tehdit puanlamasına dayalı olarak bir hedef önerisi oluşturduğunda ve bir komutan bunu saniyeler içinde onayladığında, bireyselleştirilmiş değerlendirme için yasal gerekliliklerin karşılanıp karşılanmadığı hiç de açık değildir.

28 Şubat’ta başlayan saldırılarla İran’da 2076’dan fazla kişi öldü ve 26.500 kişi yaralandı. İran Kızılayı, yaklaşık 20.000 sivil binanın ve 77 sağlık tesisinin hasar gördüğünü bildiriyor. Güney İran’da çoğunluğu çocuk olmak üzere 170’ten fazla kişinin ölümüne neden olan bir okulun bombalanmasıyla ilgili bağımsız bir soruşturma çağrıları artıyor. Yapay zekâ destekli hedeflemenin bu özel sonuçlara katkıda bulunup bulunmadığı hiçbir zaman kamuoyuna açıklanamayabilir.

Askerî hedefleme üzerine araştırmalar yapan Newcastle Üniversitesi’nden siyasi coğrafyacı Craig Jones, genel tablo konusunda açık sözlü: “Yapay zekânın sivil ölümlerini veya yanlış hedefleme kararlarını azalttığına dair hiçbir kanıt yok ve tam tersi doğru olabilir.” Yapay zekânın savaşı daha hassas ve dolayısıyla daha insancıl hale getirdiği yönündeki hassas savaş argümanı, bu sistemlerin fiilen konuşlandırıldığı çatışmaların kanıtlarıyla desteklenmiyor.

Hedefleme yapay zekasının ahlaki mimarisi

Maven, Lavender gibi sistemlerin hızı ve ölçeği, daha derin bir sorunu görünmez kılıyor: Yapay zekânın ahlaki sezgisi yoktur ve olamaz. Bir hedefleme sistemi, eğitim sürecinde belirlenen hedefe ulaşmak için optimize edilir. Hangi verilerin kullanıldığını, hangi değerlerin ve önyargıların sisteme işlendiğini ise büyük ölçüde yalnızca onu tasarlayanlar bilir. Bir patlama yarıçapındaki insanın değerini tartacak içsel bir mekanizma yoktur; çünkü insan değeri, sistemin tanıdığı bir değişken değildir. Hukuki ve ahlaki anlamda orantılılık ise mevcut yapay zekâ mimarilerinin henüz sahip olmadığı bir şeyi gerektirir: bağlama duyarlı yargı (contextual judgment).

Kontrolden çıkmış tramvay örneklemesi ahlaki yargıların kontrolü için kullanılan ikilemlerden birisidir. Tramvay ahlaki ikilemi, etik alanında kullanılan ünlü bir düşünce deneyidir; her seçeneğin bir zarara yol açtığı ve hiçbir bütünüyle masum cevabın bulunmadığı durumlarda insanların nasıl karar verdiğini sorgular. Bu ikilem, ahlakın esas olarak sonuçlara mı dayanması gerektiğini, yani en fazla sayıda insanı kurtarmayı mı öncelemesi gerektiğini, yoksa doğrudan birinin ölümüne sebep olmayı reddetmeyi mi esas alması gerektiğini tartışmaya açar. İkilemin kendisi basit ama rahatsız edicidir. Kontrolden çıkmış bir tramvayın raylarda hızla ilerlediğini ve kaçamayan beş kişiye doğru gittiğini düşünün. Siz ise tramvayı başka bir raya yönlendirebilecek bir makas kolunun yanındasınız. Eğer hiçbir şey yapmazsanız beş kişi ölecektir; ama kolu çekerseniz tramvay yön değiştirecek ve bu kez diğer raydaki bir kişiyi öldürecektir. Bu ikilemi bu kadar güçlü kılan şey, size sadece hangi sonucun daha iyi olduğunu değil, aynı zamanda hangi eylemle ahlaken yaşayabileceğinizi de sordurmasıdır. Bu sadece felsefi bir endişe değildir.

Bağlamsal yargı kapasitesinin olmaması doğrudan operasyonel sonuçlara da yansır. Tarihsel hedefleme verileriyle eğitilmiş bir yapay zeka sistemi, bu verilerde yer alan varsayımları yeniden üretecektir; bunlar arasında kimin tehdit oluşturduğu, hangi düzeyde ikincil hasarın kabul edilebilir olduğu ve kanıtların belirsiz olduğu durumlarda belirsizliğin nasıl çözülmesi gerektiği gibi varsayımlar yer alır. Eğer bu varsayımlar yanlışsa veya uluslararası hukukun kısıtlamalarından ziyade bir çatışmanın bir tarafının stratejik tercihlerini yansıtıyorsa, sistem sistematik olarak ve büyük ölçekte yanlış çıktılar üretecek, ancak doğru çalışıyormuş gibi görünecektir.

İnsan yargısının yerini yapay zeka alırsa

Avustralya Ulusal Üniversitesi’nde savaşta yapay zekanın gelecekteki kullanım alanlarını öngören büyük bir araştırma projesine liderlik eden Toni Erskine, daha az tartışılan bir riski daha ortaya koyuyor: İnsan yargısının yapay zeka ile değiştirilmesi, çatışmaları kazara tırmandırabilir. Endişe, sadece otonom sistemlerin yanlış kararlar vermesi değil, aynı zamanda bu kararların hızı ve şeffaf olmaması nedeniyle, daha yavaş ve daha bilinçli insan karar alma süreçlerinin koruyacağı diplomasi ve gerilimi azaltma olasılıklarının da ortadan kalkmasıdır.

Sorun, araştırmacıların kara kutu problemi olarak adlandırdığı durumla daha da karmaşıklaşıyor. Modern derin öğrenme sistemleri doğrudan denetlenebilecek çıktılar üretmiyor. Bir sistem size bir bireyin meşru bir hedef olma olasılığının %94 olduğunu söyleyebilir; ancak insan bir değerlendiricinin anlamlı bir şekilde değerlendirebileceği terimlerle nedenini her zaman söyleyemez. Saldırıyı onaylayan komutan, yalnızca çıktıya değil, büyük ölçüde erişilemez olan bir dizi modelleme kararına da güveniyor. Bu, askerî etik ve uluslararası hukukun tarihsel olarak insan kontrolü olarak anladığı şeyden derin bir sapmadır.

Tartışmadığımız zafiyetler

Yapay zekâ hedefleme sistemlerinin etik sorunlarının yanı sıra, özellikle bu sistemlere ne kadar çok askerî yetenek bağlı olduğu göz önüne alındığında, kamuoyu tartışmalarında çok az dikkat çeken bir dizi teknik güvenlik açığı da bulunuyor.

Yapay zekâ sistemlerinin güvenilirliği, eğitildikleri veriler ve gerçek zamanlı olarak aldıkları veriler kadar önemlidir. Çekişmeli bir askerî ortamda, bunların her ikisi de düşmanlar tarafından aktif olarak hedef alınır. Düşmanca veri zehirlenmesi (bir yapay zekâ sisteminin eğitim hattına veya gerçek zamanlı veri akışlarına kasıtlı olarak bozuk veya yanlış bilgi sokulması) sistem içinden tespit edilmesi zor veya neredeyse imkansız olacak şekilde çıktıları sistematik olarak çarpıtabilir. Sessizce manipüle edilmiş bir hedefleme yapay zekâsı, düşmanın stratejik çıkarlarına hizmet eden, makul görünen öneriler üretebilir. Maven gibi sistemlerin kapalı ve tescilli yapısı, bu tür manipülasyonun sonradan tespit edilmesini son derece zorlaştırır ve sorumluluğun belirlenmesi neredeyse mümkün değildir.

Ayrıca, her biri farklı bir alan için, farklı yükleniciler tarafından ve farklı mimariler kullanılarak tasarlanmış birden fazla yapay zeka sisteminin entegre bir savaş alanında birlikte çalışması gerektiğinde ne olacağı sorunu da vardır. Gemiler, uçaklar, kara sistemleri ve istihbarat platformları, ortak bir operasyonel tabloya katkıda bulunan çıktılar üretir. Bu sistemlerin güvenilir bir şekilde iletişim kurmasını, birbirlerinin çıktılarını doğru bir şekilde yorumlamasını ve bunu yapamadıklarında uygun hata kodları vermelerini sağlamak, birinci dereceden çözülmemiş bir sistem mühendisliği sorunudur.

Bu zaaflar varsayımsal değil. Bunlar, sivil havacılık veya ilaç onayına uyguladığımız türden bağımsız test ve sertifikasyon rejimi olmadan, hayati önem taşıyan bağlamlarda, büyük ölçekte kullanılan bir teknolojinin bilinen bilinmeyenlerini (known unknowns) temsil ediyor. Asimetri çarpıcı: Yeni bir ilacı onaylamadan önce yıllarca süren kontrollü denemelere ihtiyaç duyuyoruz; aktif savaşta öldürme listeleri oluşturmak için bir yapay zeka sistemine yetki vermeden önce ise benzer bir sürece ihtiyaç duymuyoruz.

Etik geri çekilmenin siyasi ekonomisi

Yapay zekâ yönetiminin uzun vadeli gidişatıyla ilgilenenler için İran çatışmasının en öğretici bölümü, belki de bir hedef belirleme kararı değil, saldırının başlamasından hemen önceki günlerde yaşanan, Claude modeli 2024’ten beri 200 milyon dolarlık bir sözleşmenin parçası olarak Maven Akıllı Sistemi’ne entegre edilmiş olan yapay zekâ şirketi Anthropic ile Pentagon arasındaki çatışmadır.

Ocak ayında, Savaş Bakanlığı, tüm yapay zeka sözleşmelerinin teknolojinin kısıtlama olmaksızın “herhangi bir yasal kullanım” için kullanılmasına izin vermesi gerektiğini belirten bir memorandum yayınladı. Anthropic, Claude’un kitlesel iç gözetim veya tamamen otonom silahları yönlendirmek için kullanılamayacağı konusunda ısrar ederek, güvenlik önlemlerini kaldırmayı reddetti. 27 Şubat’ta, İran saldırısının başlamasından bir gün önce, Başkan Trump, tüm federal kurumların Anthropic’in teknolojisini kullanmayı bırakmasını emretti. Savunma Bakanlığı daha sonra Anthropic’i, tarihsel olarak yabancı düşmanlar için ayrılmış bir sınıflandırma olan “tedarik zinciri riski” olarak belirledi ve bu da tüm savunma yüklenicilerinin Claude’u kullanmadıklarını onaylamalarını zorunlu kıldı.

OpenAI, saatler sonra kendi Pentagon ortaklığını duyurdu ve sözleşmenin, teknolojisinin gözetleme veya tamamen otonom silahları yönlendirme amacıyla kullanılmayacağını belirttiğini, aynı zamanda Anthropic’in reddettiği daha geniş şartları kabul ettiğini açıkladı. Piyasa sinyali açık ve netti; etik kısıtlamalar savaş zamanında ticari bir yükümlülüktür ve hükümetler bunları ortadan kaldırmak için tüm satın alma güçlerini kullanacaklardır. Sınır çizen şirket cezalandırıldı, sınırı değiştiren şirket ise ödüllendirildi.

Bir federal yargıç, kara listeye alma işlemini geçici olarak durdurdu ve ilgili kanunda, bir Amerikan şirketini sadece politika konusunda fikir ayrılığı ifade ettiği için ulusal güvenlik düşmanı olarak damgalamanın hiçbir gerekçesi olmadığını belirtti. Fakat daha geniş ilkeye verilen zarar çoktan gerçekleşmişti. Google ve OpenAI çalışanları şu anda şirket liderlerine, yapay zeka modellerinin yurt içi kitlesel gözetim için veya insan gözetimi olmadan otonom olarak insanları öldürmek için kullanılmasına izin vermemeleri çağrısında bulunan bir dilekçe hazırladılar. Bu da etik kaygıların sektör içinde yaygın olarak hissedildiğinin bir işaretidir. Bu dinamik kontrol altına alınmazsa, yapay zeka şirketlerinin sorumlu geliştirme konusunda gönüllü olarak verdikleri taahhütleri giderek zayıflatacaktır. Teşvik yapısı, etik kurallara uyan şirketleri sistematik olarak cezalandırdığında, kurumsal etiklere güvenmek yeterli değildir. Yönetişim, varoluşsal ticari baskılarla boğuşan firmaların iyi niyetine bırakılamaz.

Yönetimin gerçekte gerektireceği şeyler

Uluslararası alanda, savaşta yapay zekanın düzenlenmesine yönelik çabalar gerçek ancak ciddi şekilde kısıtlanmış durumda. Akademisyenler ve hukuk uzmanları, savaş devam ederken, Cenevre’de, Belirli Konvansiyonel Silahlar Sözleşmesi çerçevesinde uzun süredir devam eden çabaların bir parçası olarak, ölümcül otonom silah sistemlerini ve orduda yapay zeka tedarikini görüşmek üzere bir araya geldi. Stockholm Uluslararası Barış Araştırma Enstitüsü geçen ay yayınladığı bir raporda, ABD Savaş Bakanlığı’nın yapay zeka şirketleriyle şu anda bulunduğu sözleşme aşamasının, sorumlu davranış ilkelerinin net bir şekilde belirlenmesi için çok önemli bir an olduğunu belirtti.

Bütün bu çabaların en büyük engeli ise, ABD, İsrail ve Çin de dahil olmak üzere aktif yapay zekâ savaş programlarına sahip devletlerin daha fazla düzenlemeye karşı oluşudur. Askerî yapay zekâ konusunda küresel normları şekillendirme konusunda en yetenekli devletler, onu kısıtlama olmaksızın kullanmaya en çok yatırım yapan devletlerdir.

Gerçek anlamda yönetmek için gereken norm, uluslararası bağlayıcı kurallardır. Operasyonel kullanıma geçmeden önce, diğer yüksek riskli teknolojilere uyguladığımız güvenlik sertifikasyon rejimlerine benzer şekilde, yapay zeka hedefleme sistemlerinin bağımsız teknik denetimini gerektirir. Şeffaflık yükümlülükleri gerektirir; gizli sistemlerin tam olarak açıklanmasına değil, gösterilenleri değerlendirebilecek uzmanlığa sahip bağımsız denetim organlarına karşı anlamlı bir hesap verebilirliğe ihtiyaç vardır.

Yapay zekâ savaşının düzenlenememesi veya yasal kullanım konusunda bir anlaşmaya varılana kadar kullanımının durdurulamaması, yapay zekâ savaşının yayılmasının yakın olduğunu gösteriyor. Gelecekteki bir riski tartışmıyoruz. Yönetmek için tasarlanmış kurumlardan daha hızlı yayılan mevcut bir gerçeği tanımlıyoruz.

Artık varsayımların ötesine geçtik. Algoritmik savaş dönemi başladı. Tahran semalarında, Maven Akıllı Sistemi’nin hedefleme kuyruklarında, insan yargısını saniyelere sıkıştıran onay süreçleri işledi. Devlet şiddetini sınırlamak için kurduğumuz hukuk, etik ve kurumların bu duruma yetişip yetişemeyeceği, bu on yılın belirleyici yönetim sorunudur. Cevap henüz net değil. Ancak bu sistemlerin normalleştirildiği, rutinleştirildiği ve demokratik erişimin ötesine yerleştirildiği her çatışmayla birlikte, cevabı belirleme penceresi daralıyor.

Bu makalede yer alan fikirler yazara aittir ve Fikir Turu’nun editöryel politikasını yansıtmayabilir.

Bu yazı ilk kez 13 Nisan 2026’da yayımlanmıştır.