ChatGPT gibi araçlar, yazma görevleri için harcanan zamanı azaltıyor ve anlık destek sağlıyor. Ancak bu kolaylığın, bazı bilişsel maliyetleri olduğuna dair bilimsel kanıtlar artıyor. MIT’de yapılan yeni bir araştırmaya göre, Yapay Zekâ (YZ) sohbet robotlarını kullanmak, aynı görevleri yardımsız yerine getirmeye kıyasla beyin aktivitesini azaltıyor ve bilgiyi daha zayıf bir şekilde hatırlamaya yol açabiliyor. Dış kaynaklardan alınan sürekli yardım, beynin kendi içinde kurduğu düşünsel bağlantıların zamanla zayıflamasına neden olabilir. Gazeteci Brandon Vigliarolo, The Register için yazdığı makalede araştırmanın detaylarını ele alıyor.

Yazıdan öne çıkan bölümleri aktarıyoruz:

“LLM[1] sohbet robotlarının kullanımının beyni nasıl etkilediğini anlamak isteyen MIT Media Lab araştırma bilimcisi Dr. Nataliya Kosmyna liderliğindeki bir ekip, Boston bölgesindeki bir grup üniversite öğrencisini elektroensefalogram (EEG[2]) kulaklıklarına bağladı ve onlara 20 dakika içinde kısa bir deneme yazmaları için zaman verdi. Bir gruba dışarıdan yardım almadan yazmaları söylendi, ikinci gruba arama motoru kullanma izni verildi. Üçüncü bir gruba ise OpenAI’nin GPT-4o[3] modelinin yardımıyla yazmaları talimatı verildi. Bu süreç birkaç ay boyunca dört kez tekrarlandı.

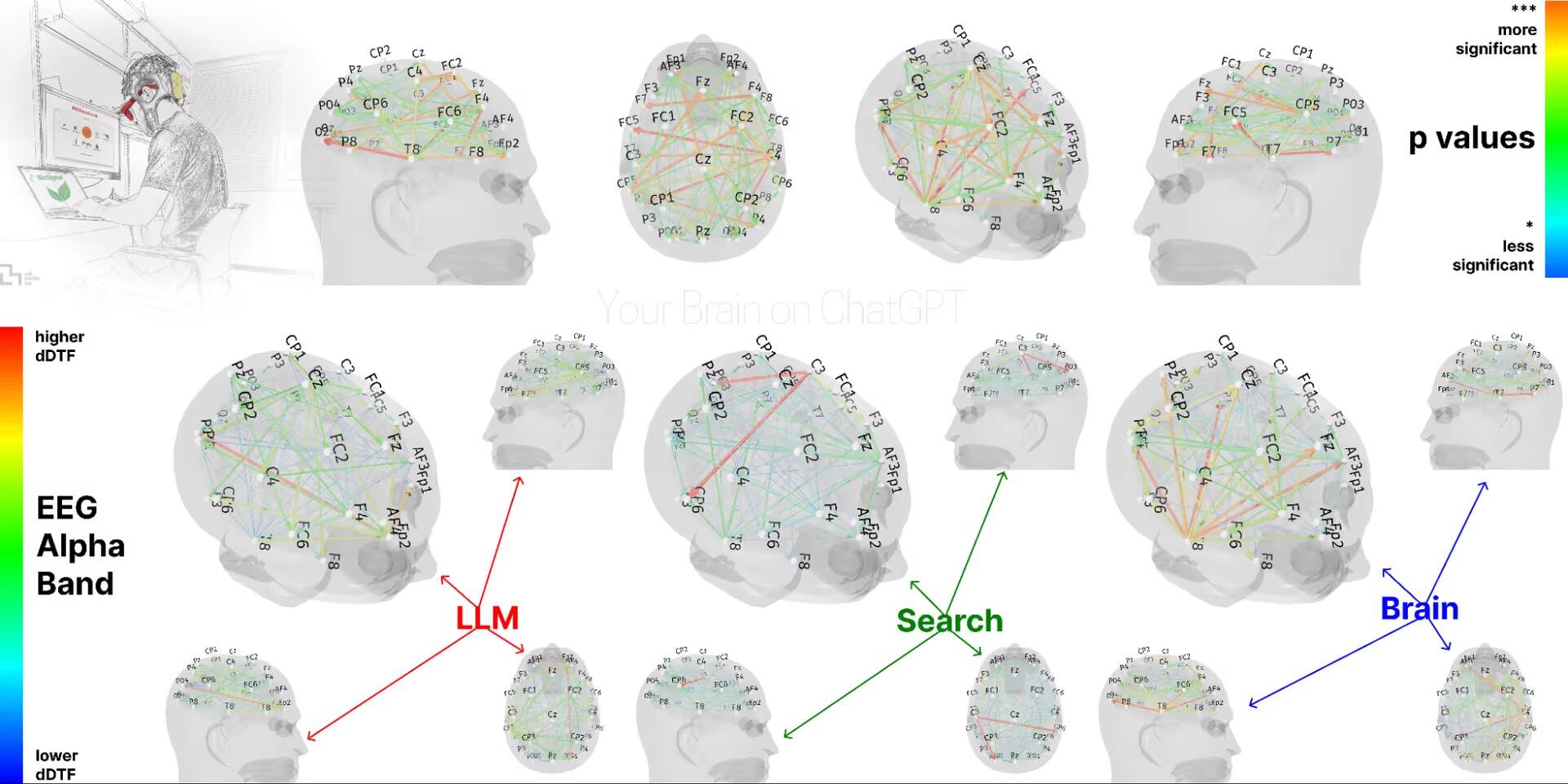

Henüz bilimsel bir kurul tarafından incelenmemiş olsa da, araştırma sonuçları, üç grubun beyin aktivitesi ile buna karşılık gelen sinir bağlantı modellerinin oluşumu arasında çarpıcı bir fark olduğunu gösteriyor.

Görsel verilerle desteklendiğinde, LLM kullanan grubun beyin aktivitesinin daha zayıf olduğu açıkça görülüyor.

Üç çalışma grubunun (soldan sağa: LLM, arama motoru ve beyin grupları) beyin aktivitesine bakıldığında, renkler ne kadar kırmızı olursa, dDTF[4] büyüklüğü o kadar aktif olduğu görülüyor.

EEG analizi, her grubun farklı sinirsel bağlantı desenleri sergilediğini ve beyin bağlantısının “dış desteğin miktarı ile sistematik olarak azaldığını” gösterdi. Başka bir deyişle, arama motoru kullanıcıları daha az beyin aktivitesi sergilerken, LLM kohortu (katılımcı grubu) “en zayıf genel bağlantıyı” ortaya çıkardı.

Katılımcıların bilişsel yükü, farklı beyin bölgeleri arasında bilgi akışıyla ilgili belirli beyin aktivitesini ölçen Dinamik Yönlendirilmiş Transfer Fonksiyonu (dDTF) adlı bir yöntem kullanılarak ölçüldü. MIT araştırmacılarına göre, dDTF akışın gücünü ve yönünü hesaba katabildiğinden, “yürütme fonksiyonu, anlamsal işleme ve dikkat düzenleme”yi iyi bir şekilde temsil ediyor.

Araştırmacılar, sadece kendi bilişsel süreçleriyle yazan grubun belirlediği temel değere kıyasla, arama motoru grubunun dDTF bağlantısında yüzde 34 ila 48 daha az bağlantı gösterdiğini belirtti. LLM grubu ise dDTF sinyal büyüklüğünde yüzde 55’e varan daha önemli bir azalma gösterdi.

Daha basit bir ifadeyle, LLM’lere ve daha az ölçüde arama motorlarına güvenmek, görevle ilgili beyin bağlantısını önemli ölçüde azaltır ve bu da kompozisyon yazma görevi sırasında bilişsel katılımın daha düşük olduğunu gösterir.

Kötü performans gözlemlendi

Araştırmacıların belirttiğine göre, bu bulgular eğitim uygulamaları ve öğrenme süreçlerini anlama biçimimiz açısından “önemli çıkarımlar” barındırıyor. Özellikle, bilginin bireysel içsel işlenmesi ile dışsal destek arasında belirgin bir denge (trade-off) olduğu ortaya konuyor.

Çalışmaya katılanlar arasında, yapay zekâ destekli büyük dil modeli (LLM) grubundaki katılımcılar, her düzeyde yalnızca kendi bilişsel süreçlerine güvenen “Beyin” grubunun gerisinde kaldı. LLM grubundakiler, hem yazdıkları bilgileri hatırlama testlerinde hem de yazdıklarını “sahiplenme” düzeyine ilişkin algı testlerinde daha düşük performans sergiledi.

Araştırma ekibi bu bulguları şu şekilde özetledi: “Bu çalışmada, yapay zekâ kullanımının öğrenme becerilerinde olası bir gerilemeye yol açabileceğini gösteriyoruz. LLM grubunun katılımcıları, tüm test seviyelerinde beyin grubundaki katılımcılardan daha kötü sonuçlar aldı.”

Bu eğilim, çalışmanın son aşamasında yapılan dördüncü deneme yazımı oturumunda da teyit edildi. Bu oturumda, katılımcıların rollerinde değişikliğe gidildi: Başlangıçta yapay zekâya güvenen grup bu kez kendi bilişsel süreçlerine dayanmaya yönlendirildi; diğer grup ise yapay zekâ kullanma izni aldı. Sonuçlar oldukça çarpıcıydı. LLM grubundakiler, kendi düşünce süreçlerine güvenmek zorunda kaldıklarında belirgin bir performans düşüşü yaşadı.

Buna karşın, beyin grubundan gelen ve bu aşamada LLM desteği kullanmalarına izin verilen katılımcılar, tanıdık bir konuda çalıştıklarında tüm EEG frekans bantlarında beyin bağlantılarında anlamlı bir artış gösterdi.

Bu durum, yapay zekânın doğru bağlamda ve zamanlamayla kullanıldığında bilişsel süreçleri destekleyebileceğine işaret ediyor.

YZ genel olarak düşünmeyi engelliyor mu?

Bulgular, öğrenme sürecinin erken aşamalarında yapay zekâ kullanımının, çabanın büyük ölçüde dış kaynaklara aktarılması nedeniyle “yüzeysel kodlamaya” yol açabileceğini ortaya koyuyor. Bu durum, bilgilerin zayıf hatırlanmasına ve kalıcı öğrenmenin engellenmesine neden olabiliyor.

Öte yandan, bireyin önce kendi bilişsel becerilerini kullanarak anlamaya çalışması, ardından yapay zekâdan araştırma ve derinleştirme amacıyla faydalanması çok daha sağlıklı bir öğrenme stratejisi olarak değerlendiriliyor.

MIT araştırma ekibi, yapay zekâ araçlarının özellikle eğitim ve bilişsel becerilerin gelişimi üzerindeki yaygın etkilerinin anlaşılmasının kritik önem taşıdığını vurguluyor. Araştırmacılara göre, bu tür araçların kullanımı problem çözme, eleştirel düşünme gibi temel bilişsel süreçleri doğrudan etkileyebilir.

Ekip ayrıca, yapay zekânın eğitim ve öğrenme üzerindeki uzun vadeli etkilerini daha kapsamlı biçimde inceleyecek yeni araştırmalara ihtiyaç duyulduğunun altını çiziyor. Bu bağlamda, yapay zekânın sorumlu ve etkili bir şekilde nasıl entegre edilebileceğine dair yol gösterici ilkelere duyulan ihtiyaç giderek artıyor.

Sonuç olarak, araştırma, yapay zekâ destekli sohbet robotlarının beyin aktivitesi ve bilgi hatırlama üzerindeki olası olumsuz etkilerine dair önemli kanıtlar sunuyor. Yapay zekânın sunduğu fırsatlar elbette inkâr edilemez, ancak bu araçları kullanırken bilişsel kapasitelerimiz üzerindeki etkilerini dikkate alarak bilinçli tercihler yapmak büyük önem taşıyor.”

Bu yazı ilk kez 27 Haziran 2025’te yayımlanmıştır.

[1] LLM (Large Language Model – Büyük Dil Modeli): İnsan dilini anlama, yorumlama ve üretme yeteneğine sahip, çok büyük veri kümeleri üzerinde eğitilmiş bir yapay zeka modelidir. ChatGPT gibi sohbet robotlarının temelini oluştururlar.

[2] EEG (Elektroensefalogram): Beynin elektriksel aktivitesini ölçmek için kafa derisine elektrotlar yerleştirilerek yapılan bir testtir. Beyin dalgalarını kaydeder ve farklı durumlar (uyku, uyanıklık vb.) veya anormallikler (nöbetler gibi) sırasında beyin aktivitesini değerlendirmek için kullanılır.

[3] GPT-4o (Generative Pre-trained Transformer 4o): OpenAI tarafından geliştirilen bir Büyük Dil Modeli sürümüdür. Metin, ses ve görüntü gibi farklı veri türlerini işleme yeteneğine sahip olduğu belirtilmiştir.

[4] dDTF (Dynamic Directed Transfer Function – Dinamik Yönlendirilmiş Transfer Fonksiyonu): Beyin bölgeleri arasındaki bilgi akışının gücünü ve yönünü zaman içinde ölçmek için kullanılan bir sinirsel bağlantı analiz yöntemidir. Metinde, katılımcıların bilişsel yükünü ve farklı beyin bölgeleri arasındaki bilgi akışını değerlendirmek için kullanılmıştır.